En bref : Privacy by Design et projets IA

- Article 25 RGPD : obligation d'intégrer la protection des données dès la conception et par défaut

- AI Act : les systèmes IA à haut risque (recrutement, santé, crédit) soumis à des exigences strictes depuis août 2026

- Double conformité : RGPD + AI Act s'appliquent simultanément dès qu'un système IA traite des données personnelles

- Sanctions cumulées : jusqu'à 4% du CA mondial (RGPD) + 7% (AI Act) = risque de 11% du CA

- Risque ultime : interdiction temporaire ou définitive d'exploiter le système IA

- Cas concrets : OpenAI (15M€ en Italie), Clearview AI (20M€ en France), Sambla Group (950K€ pour violation Privacy by Design)

Qu'est-ce que le Privacy by Design ?

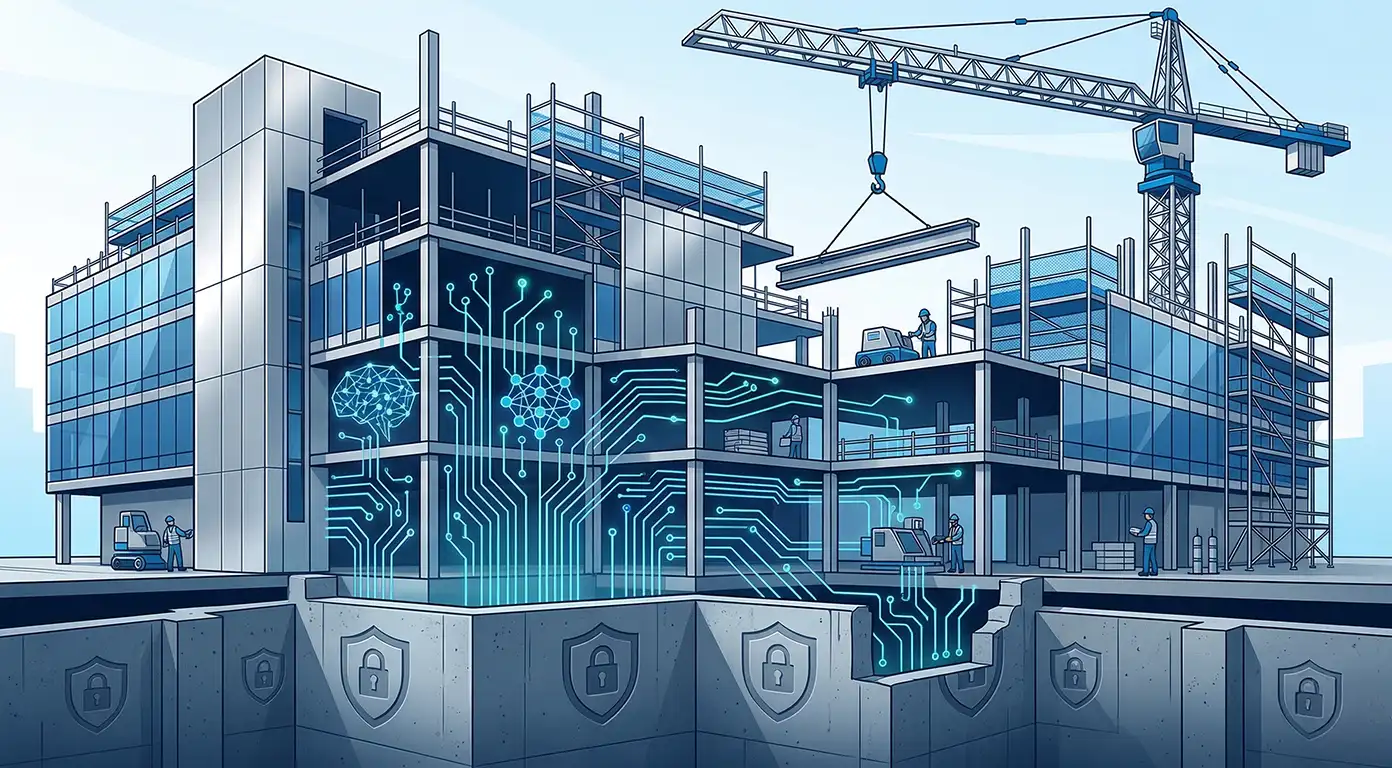

Le Privacy by Design (protection des données dès la conception) est un principe fondamental du RGPD, inscrit à l'article 25. Il impose aux responsables de traitement d'intégrer la protection des données personnelles dès la phase de conception d'un système, produit ou service, et non pas après coup.

Ce concept a été formulé dans les années 1990 par Ann Cavoukian, commissaire à la protection de la vie privée de l'Ontario. Avec le RGPD, il est devenu une obligation légale en Europe.

Les 7 principes fondamentaux

Le Privacy by Design repose sur sept principes directeurs :

- Proactif, pas réactif : anticiper les risques avant qu'ils ne surviennent

- Protection par défaut : les paramètres par défaut doivent être les plus protecteurs

- Intégration dès la conception : la protection est embarquée dans l'architecture du système

- Fonctionnalité complète : pas de compromis entre sécurité et fonctionnalité

- Sécurité de bout en bout : protection tout au long du cycle de vie des données

- Transparence : les pratiques doivent être visibles et vérifiables

- Respect de la vie privée : l'utilisateur reste au centre des préoccupations

Ce que dit l'article 25 du RGPD

L'article 25 impose au responsable de traitement de mettre en œuvre des mesures techniques et organisationnelles appropriées dès la détermination des moyens de traitement et au moment de la mise en œuvre effective.

Ces mesures doivent tenir compte de plusieurs facteurs :

- L'état des connaissances (état de l'art technologique)

- Les coûts de mise en œuvre

- La nature, la portée, le contexte et les finalités du traitement

- Les risques pour les droits et libertés des personnes

Le Privacy by Default (protection par défaut) complète ce principe : seules les données strictement nécessaires doivent être traitées, avec les paramètres les plus protecteurs activés par défaut.

Pourquoi l'IA rend le Privacy by Design incontournable

L'intelligence artificielle amplifie considérablement les enjeux de protection des données. Les systèmes d'IA présentent des caractéristiques qui rendent le Privacy by Design non pas optionnel, mais vital.

Les risques spécifiques de l'IA

Collecte massive de données : les modèles d'IA, notamment les LLM (Large Language Models), sont entraînés sur des volumes considérables de données, incluant souvent des données personnelles collectées sur internet sans consentement explicite.

Risque de réidentification : la CNIL et le CEPD (Comité européen de la protection des données) rappellent qu'un modèle d'IA entraîné sur des données personnelles doit généralement être considéré comme relevant du RGPD. Même pseudonymisées, ces données peuvent permettre une réidentification.

Biais algorithmiques : des données d'entraînement biaisées produisent des décisions discriminatoires, notamment en matière d'emploi, de crédit ou d'accès aux services.

Opacité des décisions : les systèmes d'IA peuvent prendre des décisions automatisées difficiles à expliquer, ce qui entre en conflit avec les droits des personnes concernées.

⚠️ L'idée reçue à combattre : "Le RGPD empêche l'innovation en IA" est faux, selon la CNIL elle-même. En revanche, développer une IA sans intégrer la protection des données dès le départ expose à des sanctions et à l'interdiction d'exploitation.

AI Act + RGPD : la double conformité obligatoire

Depuis l'entrée en vigueur de l'AI Act (Règlement européen sur l'intelligence artificielle), les projets IA sont soumis à une double réglementation lorsqu'ils traitent des données personnelles. Et c'est le cas de la quasi-totalité des déploiements en entreprise.

Le calendrier de l'AI Act

- Février 2025 : interdictions relatives aux IA à risque inacceptable (manipulation subliminale, scoring social, reconnaissance faciale en temps réel dans l'espace public)

- Août 2025 : obligations pour les modèles d'IA à usage général (LLM comme GPT, Claude, Mistral)

- Août 2026 : application complète des règles pour les systèmes IA à haut risque

- Août 2027 : systèmes IA intégrés dans des produits déjà réglementés (dispositifs médicaux, machines...)

Les systèmes IA à haut risque

L'AI Act classe comme "haut risque" les systèmes IA utilisés dans des domaines sensibles :

- Recrutement et gestion RH : tri de CV, évaluation des candidats, décisions de promotion

- Crédit et assurance : scoring, évaluation de solvabilité

- Santé : diagnostic assisté, triage médical

- Éducation : évaluation des étudiants, orientation

- Justice et migration : aide à la décision judiciaire, traitement des demandes d'asile

- Infrastructures critiques : gestion des réseaux d'énergie, transports

Pour ces systèmes, l'AI Act impose des exigences strictes : documentation technique complète, gouvernance des données, transparence, contrôle humain, exactitude, robustesse et cybersécurité.

Comment RGPD et AI Act s'articulent

Les deux réglementations sont complémentaires :

- Le RGPD encadre le traitement des données personnelles selon une logique centrée sur les droits des personnes

- L'AI Act encadre la conception et le déploiement des systèmes IA selon une logique de classification par le risque

Quand un système IA traite des données personnelles, les deux s'appliquent simultanément. L'AI Act ne remplace pas le RGPD : il le complète.

🚨 Sanctions cumulées : Un manquement peut être sanctionné sur les deux fondements. Le RGPD prévoit jusqu'à 4% du CA mondial, l'AI Act jusqu'à 7% pour les IA interdites, 3% pour les systèmes haut risque non conformes. Au total, une entreprise peut théoriquement risquer jusqu'à 11% de son chiffre d'affaires mondial.

Les sanctions déjà prononcées

Les autorités de protection des données européennes ont déjà sévi contre des systèmes IA non conformes au RGPD.

OpenAI : 15 millions d'euros en Italie (décembre 2024)

L'autorité italienne de protection des données (Garante) a sanctionné OpenAI pour plusieurs violations du RGPD :

- Traitement de données sans base légale valide

- Défaut de transparence sur la collecte et l'utilisation des données

- Production de données inexactes (hallucinations)

- Absence de notification d'une violation de données (mars 2023)

- Absence de vérification de l'âge des utilisateurs

OpenAI a également été contraint de lancer une campagne d'information en Italie pour sensibiliser les utilisateurs.

Clearview AI : plus de 55 millions d'euros cumulés

Cette entreprise américaine de reconnaissance faciale a été sanctionnée dans toute l'Europe pour collecte illicite de données biométriques :

- France (CNIL) : 20 millions d'euros (2022) + 5,2 millions d'euros (2023) pour non-conformité aux injonctions

- Pays-Bas : 30,5 millions d'euros

- Italie, Grèce, Royaume-Uni : amendes supplémentaires

Clearview AI refuse de se conformer aux sanctions européennes, s'engageant dans un bras de fer avec les régulateurs.

Sambla Group : 950 000€ pour violation du Privacy by Design (2025)

Cette société a été sanctionnée spécifiquement pour violation de l'article 25 du RGPD. Les griefs : absence de mesures de protection des données dès la conception, réponse tardive aux processus défaillants identifiés, et durée prolongée des manquements sans remédiation.

Mistral AI : plainte en cours devant la CNIL

La licorne française de l'IA générative fait l'objet d'une plainte pour défaut de consentement à l'entraînement des modèles et manque d'information sur les données collectées.

Risque ultime : l'interdiction d'exploitation

Au-delà des amendes, le risque le plus grave est l'interdiction temporaire ou définitive d'exploiter le système IA.

Un projet IA qui n'a pas intégré le RGPD dès sa conception peut se voir :

- Interdit de mise sur le marché européen (pas de "marquage CE" pour l'IA)

- Contraint de suspendre son exploitation le temps de se mettre en conformité

- Obligé de détruire les données d'entraînement si elles ont été collectées illicitement

- Forcé de recommencer le développement avec des données conformes

Pour une startup ou une entreprise ayant investi des millions dans le développement d'un modèle, ces conséquences peuvent être fatales.

Comment intégrer le Privacy by Design dans vos projets IA

La CNIL a publié des recommandations détaillées pour accompagner les développeurs d'IA dans leur mise en conformité. Voici les étapes clés.

1. Définir une finalité claire dès le départ

Avant tout développement, vous devez définir précisément :

- L'objectif du système IA (finalité déterminée)

- Les capacités prévisibles les plus à risques

- Les modalités d'utilisation (open source, SaaS, API...)

- Les catégories de personnes concernées

Cette finalité conditionne tout le reste : les données que vous pouvez collecter, la base légale applicable, les mesures de sécurité nécessaires.

2. Identifier la base légale applicable

Le traitement de données personnelles pour l'IA doit reposer sur l'une des bases légales du RGPD :

- Consentement explicite : difficile à obtenir pour l'entraînement massif

- Intérêt légitime : possible mais nécessite une balance des intérêts documentée

- Exécution d'un contrat : si l'IA est un service fourni à l'utilisateur

- Obligation légale : rare pour l'IA

Attention : le web scraping massif sans consentement pose des problèmes majeurs de licéité.

3. Appliquer le principe de minimisation

La CNIL précise : "Le principe de minimisation n'interdit pas d'entraîner un algorithme avec des volumes très importants de données", mais il impose de ne collecter que ce qui est strictement nécessaire à la finalité.

Concrètement :

- Évaluer si chaque catégorie de données est indispensable

- Pseudonymiser ou anonymiser quand c'est possible

- Limiter la durée de conservation des données d'entraînement

- Supprimer les données dès qu'elles ne sont plus nécessaires

4. Réaliser une analyse d'impact (AIPD)

Pour les systèmes IA à haut risque, une analyse d'impact relative à la protection des données (AIPD) est obligatoire. Elle doit documenter :

- La description du traitement et ses finalités

- L'évaluation de la nécessité et de la proportionnalité

- Les risques identifiés pour les droits et libertés

- Les mesures prévues pour atténuer ces risques

L'AIPD doit être mise à jour tout au long du cycle de vie du système.

5. Documenter rigoureusement

L'AI Act et le RGPD imposent une documentation exhaustive :

- Registre des traitements (article 30 RGPD)

- Documentation technique sur le fonctionnement de l'IA

- Cartes de données, de modèles et de systèmes (AI cards)

- Logs et traçabilité des décisions algorithmiques

- Tests et audits de biais et de sécurité

Cette documentation doit permettre de démontrer la conformité en cas de contrôle.

6. Garantir les droits des personnes

Les personnes dont les données sont utilisées conservent leurs droits RGPD :

- Droit d'information : expliquer clairement comment l'IA utilise les données

- Droit d'accès : permettre aux personnes de savoir si leurs données sont utilisées

- Droit d'opposition : offrir un mécanisme d'opt-out effectif

- Droit à l'intervention humaine : pour les décisions automatisées significatives

La CNIL a publié en décembre 2025 un outil de traçabilité pour faciliter l'exercice de ces droits sur les modèles d'IA open source.

7. Maintenir une supervision humaine

L'AI Act impose une supervision humaine effective pour les systèmes à haut risque. Le RGPD interdit les décisions entièrement automatisées ayant des effets significatifs sans possibilité d'intervention humaine.

Concrètement : l'IA peut présélectionner, mais un humain doit valider les décisions critiques (embauche, crédit, diagnostic...).

Checklist Privacy by Design pour vos projets IA

Voici les points à vérifier à chaque étape de votre projet :

Phase de conception

- Finalité du traitement définie et documentée

- Base légale identifiée et justifiée

- Catégories de données listées et minimisées

- AIPD réalisée si nécessaire

- Mesures de sécurité prévues dès l'architecture

Phase de développement

- Données d'entraînement collectées licitement

- Pseudonymisation/anonymisation appliquée

- Tests de biais et d'équité réalisés

- Documentation technique complète

- Logs et traçabilité implémentés

Phase de déploiement

- Information des utilisateurs claire et accessible

- Mécanismes d'exercice des droits opérationnels

- Supervision humaine en place

- Procédure de signalement des incidents

- Audit de conformité avant mise en production

Phase d'exploitation

- Surveillance continue des performances et des biais

- Mise à jour de la documentation

- Gestion des demandes d'exercice des droits

- Révision périodique de l'AIPD

- Audits réguliers de conformité

L'opportunité stratégique du Privacy by Design

Au-delà de l'obligation légale, le Privacy by Design représente un avantage compétitif :

Confiance des utilisateurs : dans un contexte de méfiance croissante envers l'IA, démontrer une approche responsable renforce la confiance.

Accès au marché européen : sans conformité, pas de déploiement en Europe. Le Privacy by Design est le passeport pour le marché de 450 millions de consommateurs.

Réduction des coûts : corriger un système non conforme après coup coûte infiniment plus cher que d'intégrer la conformité dès le départ.

Sécurité juridique : une documentation solide protège en cas de litige ou de contrôle.

Et pour votre site web ?

Si vous développez un système IA, votre site web doit également être conforme au RGPD. Votre politique de confidentialité doit notamment :

- Expliquer si et comment l'IA traite les données des utilisateurs

- Préciser les droits des personnes concernées

- Indiquer comment exercer le droit d'opposition à l'entraînement des modèles

RGPDKit génère automatiquement une politique de confidentialité adaptée à votre activité, incluant les mentions spécifiques aux traitements IA si nécessaire. En quelques minutes, vous disposez d'un document conforme aux exigences 2026.

En résumé

Le Privacy by Design n'est plus une option pour les projets IA. L'article 25 du RGPD l'impose depuis 2018, et l'AI Act renforce cette exigence avec des obligations spécifiques aux systèmes d'intelligence artificielle à haut risque.

Les sanctions déjà prononcées (OpenAI, Clearview AI, Sambla Group) montrent que les autorités sont prêtes à frapper fort. Et au-delà des amendes, c'est l'exploitation même du système qui peut être interdite.

La bonne nouvelle : intégrer le RGPD dès la conception n'empêche pas l'innovation. Au contraire, cela la sécurise. Les entreprises qui anticipent ces exigences transforment une contrainte légale en avantage compétitif.

Le calendrier est serré : depuis août 2026, toutes les dispositions de l'AI Act sont applicables aux systèmes à haut risque. Si votre projet IA n'a pas encore intégré le Privacy by Design, c'est maintenant qu'il faut agir.